Anmelden

JoVE Science Education

Neuropsychology

Sie haben vollen Zugriff auf diesen Inhalt durch

Nanyang Technological UniversityDekodierung auditiver Bilder mit der Multi-voxel-Musteranalyse

Überblick

Quelle: Laboratorien der Jonas T. Kaplan und der Sarah I. Gimbel-Universität von Südkalifornien

Stellen Sie sich den Klang einer Glocke läuten. Was im Gehirn passiert, wenn wir zaubern ein Geräusch, wie dies in der "inneren Ohr?" Es gibt zunehmend Beweise, dass das Gehirn nutzt die gleichen Mechanismen für die Phantasie, die für die Wahrnehmung verwendet. 1 z. B. als visuelle Bilder vorstellen, die Sehrinde aktiviert wird, und wenn Geräusche vorstellen, der auditorische Cortex engagiert. Inwieweit sind diese Aktivierungen des sensorischen Cortex jedoch spezifisch auf den Inhalt unserer Vorstellungskraft?

Eine Technik, die dazu beitragen kann, um diese Frage zu beantworten ist Multivoxel Muster Analyse (MPVA), in welche funktionalen Gehirn Bilder mit maschinellem Lernen Techniken analysiert werden. 2-3 in ein MPVA Experiment, bilden wir einen Maschine Lernalgorithmus, unter die verschiedenen Muster von Aktivitäten hervorgerufen durch verschiedene Reize zu unterscheiden. Zum Beispiel könnten wir Fragen, ob vorstellen, den Klang einer Glocke verschiedene Muster von Aktivitäten im auditorischen Kortex verglichen produziert mit vorstellen das Geräusch einer Kettensäge oder der Klang einer Violine. Wenn unsere Sichter das Gehirn Aktivitätsmuster erzeugt durch diese drei Reize voneinander zu unterscheiden lernt, können dann wir feststellen, dass der auditorische Cortex auf unterschiedliche Weise von jedem Reiz aktiviert ist. Ein Weg, diese Art von Experiment denken ist statt einer Frage einfach über die Aktivität einer Region des Gehirns, eine Frage über den Informationsgehalt dieser Region.

In diesem Experiment, basierend auf Meyer Et Al.wird 2010,4 wir cue-Teilnehmer, sich vorzustellen, dass mehrere Geräusche indem sie mit stiller Videos, die auditive Bilder evozieren dürften. Da wir interessiert die subtile Muster hervorgerufen durch Phantasie im auditorischen Kortex zu messen sind, ist es vorzuziehen, wenn die Reize in völliger Stille, ohne Störungen durch die lauten Geräusche der fMRI-Scanner dargestellt werden. Um dies zu erreichen, verwenden wir eine besondere Art von MRI Funktionsablauf spärlich zeitliche Sampling bekannt. Bei diesem Ansatz ist ein einzigen fMRI Volumen erworbenen 4-5 s nach jedem Reiz, zeitlich auf den Gipfel der hämodynamische Antwort zu erfassen.

Verfahren

1. Teilnehmer Rekrutierung

- 20 Teilnehmer zu rekrutieren.

- Teilnehmer sollten Rechtshänder und haben keine Geschichte der neurologische oder psychische Störungen.

- Teilnehmer müssen normal oder korrigiert-zu-normale Vision um sicherzustellen, dass sie in der Lage, die visuelle Hinweise richtig zu sehen sein werden.

- Teilnehmer sollten nicht Metall in ihrem Körper haben. Dies ist eine wichtige Voraussetzung aufgrund des hohen Magnetfeldes fMRI beteiligt.

- Teilnehmer sollten nicht unter Klaustrophobie leiden, da die fMRT erfordert liegen in dem kleinen Raum des Scanners trug.

2. Pre-Scan-Verfahren

- Prescan Schreibarbeit.

- Wenn die Teilnehmer ihre fMRI-Scans kommen, weisen Sie sie zum ersten füllen ein Metallsieb Form, um sicherzustellen, dass sie keine Kontraindikationen zur MRT haben, eine zufällige Ergebnisse Formular Zustimmung für ihre Scan von einem Radiologen betrachtet werden, und eine Einverständniserklärung über die Risiken und Vorteile der Studie.

- Bereiten Sie die Teilnehmer in den Scanner zu gehen, indem Sie ihren Körper, einschließlich Gürtel, Brieftaschen, Handys, Haarspangen, Münzen und Schmuck aus Metall entfernen.

3. Geben Sie Anweisungen für die Teilnehmer.

- Sagen Sie den Teilnehmern, dass sie eine Serie von mehreren kurzen Videos innerhalb des Scanners zu sehen. Diese Videos werden stumm, aber sie können evozieren einen Sound in ihre "inneren Ohr." Bitten Sie die Teilnehmer, Fokus auf und fördern Sie diese auditive Bilder, zu versuchen, "hören" so gut wie sie können.

- Betonen Sie die Teilnehmer halten ihren Kopf während des Scans.

4. Legen Sie den Teilnehmer in den Scanner.

- Geben Sie die Teilnehmer Ohrstöpsel schützen ihre Ohren vor dem Lärm der Scanner und Ohr Handys zu tragen, so dass sie den Experimentator während des Scans hören, und Sie liegen auf dem Bett mit ihrem Kopf in der Spule.

- Geben Sie die Teilnehmer den Notfall Squeeze-Ball und weisen sie es im Notfall während des Scans zu quetschen.

- Einsatz-Schaumstoff-Pads, die Teilnehmer zu sichern den Kopf in der Spule zu vermeiden übermäßige Bewegung während des Scans, und erinnern die Teilnehmer, dass es sehr wichtig, während des Scans als auch die kleinsten Bewegungsunschärfe möglichst ruhig bleiben die Bilder.

5. Datenerhebung

- Sammeln Sie hochauflösende anatomische Scan.

- Starten Sie den Scanvorgang funktionsfähig.

- Beginn der Reizdarbietung mit dem Start des Scanners zu synchronisieren.

- Um die spärlichen zeitliche Probenahme zu erreichen, legen Sie die Erfassungszeit eines MRI-Volume auf 2 s, mit einer 9-s Verzögerung zwischen Volumen übernahmen.

- Geschenk der Stille Videos über einen Laptop an einen Projektor angeschlossen. Der Teilnehmer hat einen Spiegel über ihre Augen reflektiert, dass ein Bildschirm auf der Rückseite des Scanners langweilen.

- Beginn der jedes 5-s-video-Clip 4 beginnen zu synchronisieren s nach die früheren MRT Akquisition beginnt. Dadurch wird sichergestellt, dass die nächste MRT Lautstärke erworbenen 7 s nach dem Start des video-Clips, um die hämodynamische Aktivität zu erfassen, die bis zur Mitte des Films entspricht.

- Stellen drei verschiedene Stille Videos, die lebendige akustische Bilder hervorrufen: eine Glocke schwingt hin und her, eine Kettensäge schneiden durch einen Baum, und eine Person, eine Geige zu spielen.

- Präsentieren Sie in jeder funktionalen Scan jedes Video 10 Mal in zufälliger Reihenfolge. Mit jeder Studie dauert 11 s, dadurch wird ein Scan 330 s (5,5 min) lang.

- Durchführen Sie 4 funktionelle Scans.

(6) Datenanalyse

- Definieren einer Region of Interest (ROI).

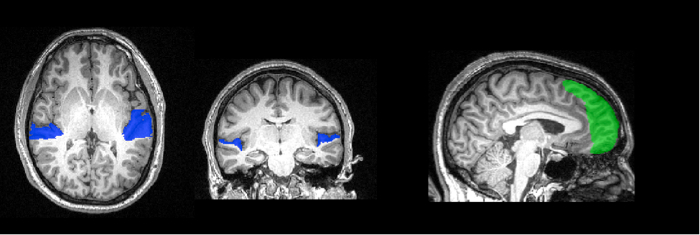

- Verwenden Sie die hochauflösende anatomische Scan eines jeden Teilnehmers die Voxel zu verfolgen, die die frühen auditorischen Kortex (Abbildung 1) entsprechen. Dies entspricht der Oberfläche des Schläfenlappens, das Planum Temporale bezeichnet. Verwenden Sie die anatomischen Gegebenheiten des Gehirn jede Person, um eine Maske zu erstellen, die spezifisch für ihre auditorischen Kortex.

Abbildung 1: Region des Interesses Tracing. Die Oberfläche des Planum Temporale hat auf hochauflösende anatomische Bild des Teilnehmers verfolgt worden und ist hier in blau angezeigt. Grün ist die Control-Maske der vorderen Stange. Diese Voxel wird für MVPA Analyse verwendet werden.

- Vorverarbeitung der Daten.

- Führen Sie Bewegungskorrektur um Bewegungsartefakte zu reduzieren.

- Zeitliche Filterung um Signal Drifts zu entfernen.

- Trainieren und Testen des Klassifikator-Algorithmus.

- Teilen Sie die Daten in Trainings- und Testsätze. Trainingsdaten werden verwendet, um die Klassifizierung zu trainieren, und die Links-Out Testdaten werden verwendet werden, um zu beurteilen, was es gelernt hat. Um die Unabhängigkeit der Trainings- und Testdaten zu maximieren, lassen Sie Daten aus einem funktionalen Scan als Testsatz.

- Einen Support Vector Machine-Algorithmus auf die beschrifteten Trainingsdaten auditorischen Kortex in jedem Fach zu trainieren. Testen Sie der Sichter Fähigkeit zu erraten, die Identität der unbeschrifteten Testsatz und zeichnen Sie der Sichter Genauigkeit auf.

- Wiederholen Sie diesen Vorgang 4 Mal, jeder Scan als Testdaten jedes Mal weglassen. Diese Art von Verfahren, in dem jeder Abschnitt der Daten einmal ausgelassen ist nennt man Kreuzvalidierung.

- Kombinieren Sie Klassifikator Genauigkeiten über 4 Kreuzvalidierung Falten durch Mittelwertbildung.

- Statistische Tests

- Um festzustellen, ob die Sichter leistungsfähiger ist als Chance (33 %), können wir Ergebnisse auf Gruppenebene dem Zufall vergleichen. Um dies zu tun, sammeln Sie die Genauigkeiten für jedes Fach, und testen Sie, ob die Verteilung von Chance mit einem nicht-parametrische Wilcoxon Signed-Rank-Test unterscheidet.

- Wir können auch Fragen, ob die Klassifizierung als Chance für jeden einzelnen leistungsfähiger ist. Um die Wahrscheinlichkeit einer bestimmten Genauigkeit Ebene in Möglichkeit Daten zu ermitteln, erstellen Sie eine null Verteilung von Ausbildung und Prüfung des MVPA Algorithmus auf Daten, deren Bezeichnungen nach dem Zufallsprinzip gemischt worden haben. Permutiert die Etiketten 10.000 Mal eine null Verteilung der Genauigkeitsangaben zu erstellen, und dann vergleichen Sie die tatsächlichen Genauigkeitswert zu dieser Verteilung.

- Um die Besonderheit der Informationen innerhalb der auditorischen Kortex zu demonstrieren, wir trainieren und Testen der Sichter auf Voxel aus einem anderen Ort im Gehirn. Hier verwenden wir eine Maske aus der frontalen Pole, eine probabilistische Atlas entnommen und angepasst jedes Thema individuellen Gehirns verzogen.

Ergebnisse

Die durchschnittliche Klassifikator Genauigkeit in das Planum Temporale über alle 20 Teilnehmer lag bei 59 %. Nach der Wilcoxon Signed-Rank-Test ist das deutlich anders von 33 % Chance. Die mittlere Leistung in der frontalen Pol-Maske war 32,5 %, das ist nicht größer als Chance (Abbildung 2).

Abbildung 2. Klassifizierung-Leistung in jeder Teilnehmer. Für die drei-Wege-Klassifizierung beträgt Chance Leistung 33 %. Laut einer Permutationstest, das alpha-Niveau von p < 0,05 entspricht 42 %.

Die Permutationstest ergab, dass nur 5 % der Permutationen Genauigkeit mehr als 42 % erreicht; Somit ist unsere statistische Schwelle für einzelne Fächer 42 %. 19 der 20 Probanden hatten Klassifikator Leistung signifikant größer als Chance mit Voxel aus dem Planum Temporale, während keiner Leistung größer als Chance mit Voxel aus der frontalen Pole hatte.

So sind wir in der Lage, erfolgreich von Aktivitätsmuster im auditorischen Kortex vorherzusagen, die von den drei Klängen der Teilnehmer stellte. Konnten wir nicht machen diese Vorhersage basiert auf Aktivitätsmuster aus der frontalen Pole, was darauf hindeutet, dass die Informationen nicht global im gesamten Gehirn.

Anwendung und Zusammenfassung

MVPA ist ein nützliches Werkzeug für das Verständnis, wie das Gehirn Informationen darstellt. Anstatt den zeitlichen Verlauf von jedem Voxel getrennt wie in einem traditionellen Aktivierungsanalyse, hält diese Technik Muster über viele Voxel auf einmal bietet erhöhten Empfindlichkeit gegenüber Univariate Techniken. Eine multivariate Analyse deckt oft Unterschiede, wo eine Univariate Technik nicht in der Lage ist. In diesem Fall erfuhren wir etwas über die Mechanismen von mentalen Bildern durch Sondierung den Informationsgehalt in einem bestimmten Bereich des Gehirns, den auditorischen Cortex. Die Content-spezifische Art der diese Aktivierungsmuster wäre schwierig mit univariaten Ansätze zu testen.

Es gibt weitere Vorteile, die aus Richtung der Inferenz in dieser Art von Analyse kommen. In MVPA wir mit Muster der Hirnaktivität starten und versuchen, etwas über den psychischen Zustand des Teilnehmers abzuleiten. Diese Art von "Gehirn-Lesung" Ansatz führen zu die Entwicklung von Gehirn-Computer Schnittstellen und kann neue Möglichkeiten für die Kommunikation mit Menschen mit Sprachstörung oder Bewegung.

Referenzen

- Kosslyn, S.M., Ganis, G. & Thompson, W.L. Neural foundations of imagery. Nat Rev Neurosci 2, 635-642 (2001).

- Haynes, J.D. & Rees, G. Decoding mental states from brain activity in humans. Nat Rev Neurosci 7, 523-534 (2006).

- Norman, K.A., Polyn, S.M., Detre, G.J. & Haxby, J.V. Beyond mind-reading: multi-voxel pattern analysis of fMRI data. Trends Cogn Sci 10, 424-430 (2006).

- Meyer, K., et al. Predicting visual stimuli on the basis of activity in auditory cortices. Nat Neurosci 13, 667-668 (2010).

pringen zu...

Videos aus dieser Sammlung:

Now Playing

Dekodierung auditiver Bilder mit der Multi-voxel-Musteranalyse

Neuropsychology

6.4K Ansichten

Das Split-Brain

Neuropsychology

68.2K Ansichten

Motorische Karten

Neuropsychology

27.5K Ansichten

Eine Perspektive aus der Neuropsychologie

Neuropsychology

12.0K Ansichten

Entscheidungsfindung und die Iowa Gambling Task

Neuropsychology

32.4K Ansichten

Exekutivfunktionen bei Autismus-Spektrum-Störungen

Neuropsychology

17.7K Ansichten

Anterograde Amnesie

Neuropsychology

30.3K Ansichten

Physiologische Korrelate der Emotionserkennung

Neuropsychology

16.2K Ansichten

Ereignisbezogene Potenziale und die Oddball-Aufgabe

Neuropsychology

27.4K Ansichten

Sprache: N400 bei semantischer Inkongruenz

Neuropsychology

19.6K Ansichten

Lernen und Gedächtnis: Die Remember-Know Aufgabe

Neuropsychology

17.1K Ansichten

Messung von Unterschieden der grauen Substanz mittels Voxel-basierter Morphometrie: Das musikalische Gehirn

Neuropsychology

17.3K Ansichten

Visuelle Aufmerksamkeit: fMRI Untersuchung der objektbasierten Aufmerksamkeitskontrolle

Neuropsychology

41.5K Ansichten

Diffusions-Tensor-Bildgebung bei traumatischen Hirnverletzungen

Neuropsychology

16.7K Ansichten

Verwendung von TMS zur Messung motorischer Erregbarkeit während der Beobachtung einer Handlung

Neuropsychology

10.1K Ansichten

Copyright © 2025 MyJoVE Corporation. Alle Rechte vorbehalten

Wir verwenden Cookies, um Ihre Erfahrung auf unserer Website zu verbessern.

Indem Sie unsere Website weiterhin nutzen oder auf „Weiter“ klicken, stimmen Sie zu, unsere Cookies zu akzeptieren.