Method Article

모델 기반 포즈 추정 개발 및 신규 사용자 교육을 위한 Biplanar Videoradiography Dataset

요약

이 작업은 마커 기반 방법으로 추정된 뼈 포즈가 있는 생체 내 데이터 세트를 제공합니다. 여기에는 모델 기반 포즈 추정에 대한 초기 추정치를 개선하고 작업자 간 변동성을 줄이는 방법을 교육하는 방법이 포함되어 있습니다.

초록

작은 발 뼈의 움직임을 측정하는 것은 병리학적 기능 상실을 이해하는 데 중요합니다. 이평면 비디오방사선 촬영은 생체 내 뼈의 움직임을 측정하는 데 적합하지만, 각 뼈의 회전 및 이동(자세)을 추정할 때 문제가 발생합니다. 뼈의 포즈는 일반적으로 마커 또는 모델 기반 방법으로 추정됩니다. 마커 기반 방법은 매우 정확하지만 침습성으로 인해 in vivo 에서는 흔하지 않습니다. 모델 기반 방법이 더 일반적이지만 현재 사용자 입력 및 실험실별 알고리즘에 의존하기 때문에 정확도가 떨어집니다. 이 작업은 종골, 거골 및 경골 자세의 희귀한 생체 내 데이터 세트를 제시하며, 이는 달리기 및 호핑 중에 마커 기반 방법으로 측정됩니다. 마커 기반 시각적 피드백을 사용하여 모델 기반 포즈 추정 소프트웨어에 대한 초기 추측을 개선하도록 사용자를 교육하는 방법이 포함되어 있습니다. 새로운 작업자는 모델 기반 소프트웨어의 전문 사용자와 유사하게 마커 기반 포즈의 회전 2°와 이동 1mm 이내의 뼈 포즈를 추정할 수 있었으며, 이는 이전에 보고된 작업자 간 변동성에 비해 상당한 개선을 나타냅니다. 또한 이 데이터 세트는 다른 모델 기반 포즈 추정 소프트웨어를 검증하는 데 사용할 수 있습니다. 궁극적으로 이 데이터 세트를 공유하면 사용자가 양면 비디오 방사선 촬영에서 뼈 자세를 측정할 수 있는 속도와 정확도가 향상될 것입니다.

서문

작은 발 뼈의 움직임을 측정하는 것은 병리학적 기능 상실을 이해하는 데 매우 중요합니다. 그러나 동적 발 뼈 움직임 측정은 뼈와 관절의 작은 크기와 빽빽하게 밀집된 구성으로 인해 어렵습니다 1,2. BVR(Biplanar Videoradiography) 기술은 역동적인 활동 중에 발과 발목의 작은 뼈의 생체 내 3차원(3D) 움직임을 측정하는 데 매우 적합합니다. BVR은 동적 모션의 X선을 가시광선으로 변환하는 이미지 증폭기에 결합된 두 개의 X선 소스를 사용하여 관절 운동학에 대한 통찰력을 제공합니다. 캡처 볼륨을 통해 발이 움직이면 고속 카메라가 이미지를 캡처합니다. 이미지는 왜곡되지 않고 보정된 카메라 위치 3,4를 사용하여 캡처 볼륨으로 투사됩니다. 6 자유도(6 d.o.f.), 뼈 포즈(위치는 3 d.o.f., 방향은 3 d.o.f.)는 마커 기반 또는 모델 기반 방법3을 사용하여 추정됩니다.

마커 또는 모델 기반 포즈 추정 방법은 실험실과 분야에 따라 다릅니다. 동적 BVR 자세 측정의 황금 표준은 관심 뼈 4,5에 작은 탄탈륨 마커를 이식하는 것입니다. 포즈를 추정하려면 뼈당 최소 3개의 마커가 필요하며, 추가 마커가 있으면 정확도가 높아집니다 5,6. 이 방법은 외과적 임플란트가 필요하기 때문에 침습성으로 인해 생체 내에서는 덜 일반적이며, 마커는 뼈에 영구적으로 삽입됩니다7. 또는 모델 기반 추적은 컴퓨터 단층 촬영(CT) 또는 자기 공명 영상과 같은 다른 이미징 양식의 체적 정보를 사용하여 BVR 이미지 2,3,8,9,10,11,12,13,14,15 에서 모델을 재현합니다 . 그런 다음 일반적으로 사용자 입력을 초기 추정으로 사용하고 교차 상관 최적화 3,8,9,10,15를 사용하여 이미지와 가장 잘 일치하도록 모델을 반수동으로 조작합니다(로토스코핑). 모델 기반 포즈 추정은 덜 침습적이므로 더 일반적이지만 처리 시간이 더 길고 사용자 입력이 필요합니다. 로토스코핑 프로세스는 현재 반수동이기 때문에 작업자 간 RMS(Root Mean Square) 오차 범위가 0.83mm에서 4.96mm,단일 축을 따라 또는 약 1축을 따라 0.58°에서 10.29°까지 다양할 수 있으므로 실험실 전용 소프트웨어에서 작업자를 안정적으로 교육해야 할 필요성이 남아 있습니다. 또한 모델 매칭 알고리즘이 개선되고 있지만 가능한 한 생체 내 조건에 가까운 실험 패러다임을 사용한 검증이 필요합니다.

모델 기반 포즈 추정의 정확도는 종종 마커 기반 메트릭에 대해 평가됩니다. 예를 들어, 마커가 이식된 인간의 사체 발은 시뮬레이션된 운동 위치 13,14,16을 통해 이동되었습니다. 그런 다음 캡처된 BVR 이미지는 모델 기반 로토스코핑 방법에 공급되고 정확도(바이어스 및 정밀도)를 위해 마커 기반 메트릭과 비교됩니다. 정적 사체 발을 사용하는 것은 유용한 접근 방식이지만 실제 생체 내 뼈 자세의 정확도를 평가하는 데는 한계가 있습니다. 예를 들어, 관절 위치는 근육 활동이 없고 생체 내 부하가 있는 사체 발에서 상대적으로 일정합니다. 따라서 다양한 운동 작업에서 관절 운동의 한계를 나타내지 않을 수 있습니다. 관절 자세의 변화는 BVR 이미지의 폐색을 변화시키며, 이는 작고 조밀하게 밀집된 발 뼈 자세를 추정할 때 측정 오류의 원인이 됩니다13. 또한 이미지 매칭 알고리즘을 사용할 때 BVR 이미지에 마커가 있으면 결과가 편향될 수 있습니다. 그룹은 컴퓨터 단층 촬영(CT) 디지털 이미징 및 의학 통신(DICOM) 이미지9,14,16에서 마커를 제거했지만, 이중평면 비디오 방사선 촬영 이미지에서도 가끔 제거되기도 합니다 16.

이 연구는 발과 발목 뼈에 마커를 이식한 생체 내에서 깡충깡충 뛰고 달리는 참가자의 오픈 소스 BVR 데이터 세트를 제공합니다(그림 1). 경골, 거골 및 종골의 생체 내 뼈 움직임에 대한 마커 기반 포즈 추정이 제공됩니다. 모델 기반 추적 정확도 평가 중에 도입된 편향을 제한하기 위해 X-ray 및 CT 이미지 모두에서 마커를 제거했습니다. 이 데이터 세트는 모델 기반 포즈 추정 소프트웨어의 정확도를 평가하고 반수동 프로세스에 대한 초기 포즈 추정치 선택을 개선하기 위한 것입니다. BVR 이미지 처리 파이프라인의 속도와 정확성을 개선하고자 하는 개인과 초기 포즈 추정에서 낮은 작업자 간 변동성을 원하는 실험실에 가장 적합합니다.

그림 1: 제공된 BVR(Biplanar Videoradiography) 데이터 세트의 개요. 이식된 마커는 뼈 자세 추정을 위한 황금 표준으로 생체 내에서 추적됩니다. 마커는 모델 기반 추적의 편향을 방지하기 위해 BVR 이미지와 컴퓨터 단층 촬영 스캔에서 디지털 방식으로 제거되었습니다. 모델 기반 추적 소프트웨어에서 추정된 포즈는 마커 기반 추적의 황금 표준과 비교할 수 있습니다. 마커 기반 포즈 추정은 모델 기반 추적을 위한 초기 뼈 포즈 추정을 개선하도록 새로운 작업자를 교육하는 데에도 사용할 수 있습니다. 이 그림의 더 큰 버전을 보려면 여기를 클릭하십시오.

프로토콜

실험 프로토콜은 Queen's University Health Sciences 및 Affiliated Teaching Hospitals Research Ethics Board의 승인을 받았습니다. 참가자는 데이터 수집에 참여하기 전에 정보에 입각한 동의를 했습니다.

1. 환자 준비 및 데이터 세트 생성

참고: 참가자(남성, 49세, 83kg, 키 1.75m)는 이전에 종골(3개 마커), 거골(4개 마커) 및 경골(5개 마커; 그림 1).

- 픽셀 크기가 0.500mm 이하이고 슬라이스 두께가 0.625mm 이하인 발목을 최대한 구부린 자세로 참가자의 발에 금속 아티팩트 감소 알고리즘(금속 임플란트로 인한 이미지 왜곡을 줄이기 위해)으로 CT 스캔을 획득합니다.

참고: 여기에서 참가자의 오른발을 0.441mm x 0.441mm x 0.625mm의 해상도로 스캔했습니다. 마커의 위치는 뼈4 내의 특정 해부학적 위치에 배치되지 않습니다. 대신, 뼈 전체에 분포되어 있습니다5. - biplanar videoradiography를 수집하고 데이터를 자세히 처리하는 방법은17을 참조하십시오. 간단히 말해서, 참가자에게 발이 양평면 비디오 방사선 촬영 볼륨에 닿도록 시작 위치를 큐레이팅하여 원하는 동작을 완료하도록 요청합니다. 보정 개체와 왜곡 해제 그리드를 사용하여 카메라를 찾고 이미지를 왜곡 해제하는 등각각 18.

참고: 이 연구의 참가자는 두 가지 다른 동작에 대한 시험을 완료했습니다. 그들은 108bpm의 메트로놈으로 뛰어올라 볼륨을 천천히 조깅했다. 이미지는 1111μs 셔터 속도로 250Hz에서 지속적으로 캡처되었으며 X-ray 시스템은 70kV 및 100mA로 설정되었습니다. - 3D 의료 영상 처리 소프트웨어를 사용하여 마커를 개별적으로 분할합니다. 래스터 그래픽 편집기의 내용 인식 채우기 알고리즘과 알려진 마커 위치를 사용하여 DICOM 이미지에서 마커를 제거합니다. 뼈 부분 볼륨과 테셀레이션 메시를 마커가 없는 이미지의 분할로 만듭니다(17). 부분 볼륨과 메시를 모두 정렬하고 CT 공간에 저장합니다.

- 각 프레임에 대해 XMALab에 있는 각 마커의 필터링되지 않은 x-y 이미지 좌표를 표로 만들고18로 내보냅니다. MATLAB의 Computer Vision Toolbox를 사용하여 3D 좌표를 삼각 측량합니다. 최소 제곱 접근법19를 사용하여 X-ray 공간의 3D 마커 위치를 CT 공간의 구 맞춤 중심과 일치시켜 포즈를 추정합니다. 래스터 그래픽 편집기에서 동일한 알고리즘을 사용하여 X-ray 이미지에서 마커를 제거하고 추적을 준비합니다.

2. 데이터셋 및 코드 액세스

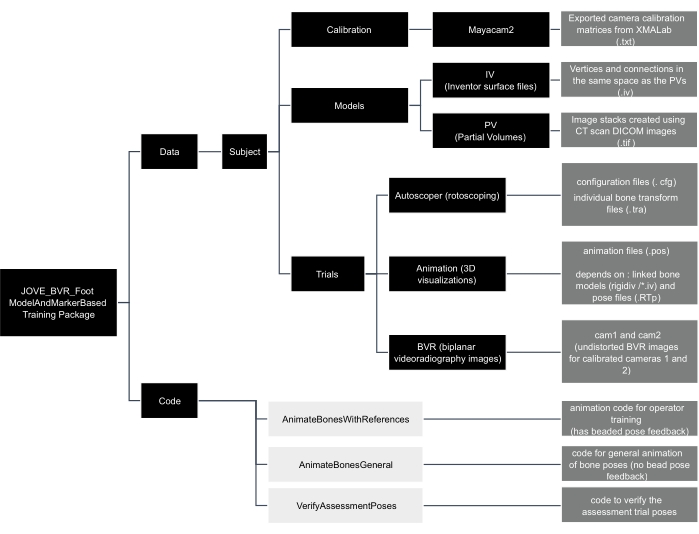

- 여기에서 데이터 세트를 다운로드합니다. 각 시험에 대한 BVR 이미지 및 보정 파일뿐만 아니라 .tra 형식으로 저장된 참조 포즈 추정치가 있습니다(그림 2). 다음에서 코드 패키지를 다운로드/복제합니다: https://github.com/skelobslab/JOVE_BVR_FootModelAndMarkerBased.

그림 2: JOVE_BVR_Foot_ModelAndMarkerBased 교육 패키지의 데이터 트리. 폴더는 검은색 상자로, 코드는 밝은 회색 상자로, 파일 설명은 짙은 회색 상자 안에 표시됩니다. 이 그림의 더 큰 버전을 보려면 여기를 클릭하십시오.

3. 모델 추적 알고리즘의 정확성 평가

- 포즈 추정치를 평가판의 참조 폴더에 .tra 파일로 저장합니다. 뼈 공간에서 엑스레이 공간까지의 포즈가 있는 .tra 파일을 1행 x 16열 형식으로 작성하고, 각 행은 프레임에 해당하고 4 x 4 포즈 매트릭스는 [첫 번째 열, 두 번째 열, 세 번째 열 및 네 번째 열]로 작성됩니다.

참고: 뼈 공간은 이 데이터 세트에서 CT 공간과 동의어입니다. - 컴퓨팅 플랫폼에서 스크립트 verifyAssessmentPoses.m을 연 다음 실행(Run)을 클릭하여 포즈 추정치를 확인합니다. 프롬프트에 설명된 대로 파일을 로드합니다. 이 스크립트는 모델 기반 포즈 추정치와 마커 기반 포즈 추정치 사이의 나선형 축을 계산하고 추적된 데이터의 각 프레임에 대한 회전 및 변환 차이를 반환합니다.

4. 새로운 작업자 교육

참고: 이 섹션에서는 새로운 작업자를 위한 피드백과 함께 교육에 대해 설명합니다. 여기서 Autoscoper는 선택된 모델 기반 포즈 추정 소프트웨어이지만 다른 소프트웨어를 대체로 사용할 수 있습니다.

- https://simtk.org/projects/autoscoper 에서 최신 버전의 포즈 추정 소프트웨어를 다운로드하십시오.

- 로컬 BVR 파일을 찾으려면 텍스트 편집기(.\JOVE_BVR_Foot_ModelAndMarkerBased\Data\SOL001A\T0019_jog0001\Autoscoper\POINTER_T0019_jog001.cfg)에서 파일을 엽니다. 소프트웨어는 포인터 파일(.cfg)을 사용하여 파일을 찾습니다. 적절한 로컬 파일로 연결되도록 디렉토리를 수정합니다. 파일을 저장하고 닫습니다.

- BVR 이미지와 카메라 정보를 불러오려면 포즈 추정 소프트웨어를 열고 시험판 불러오기를 클릭하십시오. 이전 단계에서 저장한 포인터 구성 파일로 이동하여 Open(열기)을 클릭합니다.

- 추적하려면 Akhbari et al17 (모델 기반 추적)의 프로토콜을 따릅니다. 간단히 말해서, 종골의 위치와 방향이 만족스러울 때까지 뼈의 축을 클릭하고 드래그하여 뼈를 회전하고 이동합니다. 키보드의 S 키를 눌러 종골(cal)에 대한 현재 프레임을 저장합니다.

참고: 필터 설정은 Akhbari et al17과 같이 필터링에 사용할 수 있는 \JOVE_BVR_Foot_ModelAndMarkerBased\Data\SOL001A\T0019_jog0001\Autoscoper\에 포함되어 있습니다. - 파일을 저장하려면 추적 저장을 클릭합니다. 원하는 디렉토리 아래에 파일을 [평가판 번호]_[주제 번호]_[평가판 이름]_[3자 뼈 코드].tra(예: T0019_SOL001A_jog0001_cal.tra)로 저장합니다. 설정을 현재, 행렬, 열, 쉼표, 없음, mm, 도로 내보냅니다.

참고: 경골과 거골의 세 글자로 된 뼈 코드는 각각 tib와 tal입니다. - 정확도를 추적하기 위한 파일을 만들려면 컴퓨팅 플랫폼을 열고 code 폴더에서 animateBonesWithReferences.m 스크립트를 실행하십시오. 대화 상자에서 요청한 대로 학습 패키지 내의 폴더로 이동합니다.

참고: animateBonesWithReferences.m 코드는 새로운 운영자의 추적을 개선하기 위해 마커 기반 데이터의 포즈를 피드백으로 제공하는 교육용 특수 코드입니다. - 다음에서 시각화 소프트웨어를 설치하십시오 : https://github.com/DavidLaidlaw/WristVisualizer/tree/master. 추적을 시각화하려면 시각화 소프트웨어에서 4.6단계에서 만든 .pos 파일을 엽니다. 파일 위치는 컴퓨팅 플랫폼의 명령 창에 있습니다.

- 추적된 뼈(회색)와 참조 뼈의 정렬을 확인합니다. 녹색은 포즈가 회전 및 이동 임계값 내에 있음을 나타내고 빨간색은 임계값을 벗어났음을 나타냅니다. 모든 프레임이 녹색이 될 때까지 계속 추적하고 시각화합니다. 필요한 경우 animateBonesWithReferences.m 스크립트의 10행과 11행에서 임계값(phi - rotation, trans - translation)을 변경합니다.

참고: 참조 뼈대가 빨간색이면(그림 3A) 나선형 축을 사용하여 측정한 포즈가 마커 기반 포즈에서 1mm 또는 2° 이상 떨어져 있음을 의미합니다. 녹색이고 시각적으로 합리적이면 해당 프레임이 충분히 잘 추적된 것입니다(그림 3B). - 발목 복합체의 다른 뼈를 추적하려면 거골과 경골에 대해 4.4-4.8단계를 반복합니다. 시각화 소프트웨어를 사용하여 뼈가 충돌하지 않는지 확인합니다.

- 평가를 완료하려면 평가 시험이라고 하는 시험에서 경골, 거골 및 종골을 추적하고 시각화합니다.

- 컴퓨팅 플랫폼을 열고 animateBonesGeneral.m 코드를 실행합니다. 대화 상자에서 요청한 대로 학습 패키지 내의 폴더로 이동합니다. 시각화 소프트웨어에서 .pos 파일을 사용하여 뼈 포즈를 확인합니다. 이 코드는 뼈의 3D 시각화를 위한 다른 시도로 일반화할 수 있습니다.

참고: 실제 마커 기반 포즈는 더 이상 사용할 수 없습니다. 회색 뼈만 존재합니다.

- 컴퓨팅 플랫폼을 열고 animateBonesGeneral.m 코드를 실행합니다. 대화 상자에서 요청한 대로 학습 패키지 내의 폴더로 이동합니다. 시각화 소프트웨어에서 .pos 파일을 사용하여 뼈 포즈를 확인합니다. 이 코드는 뼈의 3D 시각화를 위한 다른 시도로 일반화할 수 있습니다.

- 추정된 포즈를 평가하려면 컴퓨팅 플랫폼에서 verifyAssessmentPoses.m 스크립트를 열고 실행을 클릭하십시오. 이 스크립트는 모델 기반 포즈 추정치와 마커 기반 포즈 추정치 사이의 나선형 축을 계산하고 추적된 데이터의 각 프레임에 대한 회전 및 변환 차이를 반환합니다. 이렇게 하면 animateBoneswithReferences.m에서와 동일한 그래프가 생성되지만 애니메이션은 생성되지 않습니다.

- 모든 데이터 점이 회전 및 평행 이동에 대해 선택한 임계값(플랫 라인) 미만인지 확인합니다. 필요한 경우 결과를 .csv 파일에 저장합니다.

그림 3: 허용 가능한 추적과 허용되지 않는 추적의 시각화. (A) 모델 기반 추적(회색, 회색 화살표로도 표시)을 사용하여 추적된 칼케네우스 뼈는 마커 기반 포즈 추정치(빨간색, 빨간색 화살표로도 표시)의 포즈와 충분히 일치하지 않습니다. (B) 마커 기반 포즈 추정치의 포즈와 충분히 일치하는 Calcaneus. 마커 추적 종골은 결과적으로 녹색으로 표시됩니다(회색 및 녹색 화살표로도 표시됨). 이 그림의 더 큰 버전을 보려면 여기를 클릭하십시오.

결과

2명의 새로운 작업자와 1명의 전문가가 모델 기반 교육을 이수했습니다. 평가 시험의 41개 프레임은 모델 기반 추적의 숙련도를 측정했습니다(그림 4). 작업자의 포즈 추정치는 일반적으로 설정된 임계값보다 훨씬 낮았습니다. 뼈를 가로지르는 회전의 평균 중앙값 바이어스(범위)는 종골의 경우 0.75°(0.69° - 0.85°), 거골의 경우 0.40°(0.37° - 0.46°), 경골의 경우 0.89°(0.76° - 1.07°)였습니다. 평균 중앙값 이동 편향은 종골의 경우 0.10mm(0.05mm에서 0.16mm), 거골의 경우 0.31mm(0.22mm에서 0.41mm), 경골의 경우 0.33mm(0.27mm에서 0.37mm)였습니다. 이러한 결과는 튜토리얼이 설정된 허용 오차 내로 작업자를 교육하는 데 효과적임을 시사합니다.

그림 4: 새로운 작업자와 전문가를 위한 회전 및 변환 편향. (A)(B) 종골, (C)(D) 거골 및 (E)(F) 경골에 대한 두 명의 새로운 연산자와 한 명의 전문가에 대한 모델 기반 및 마커 기반 포즈 추정치 간의 (A)(C)(E) 회전 및 (B)(D)(F) 변환의 바이어스를 보여주는 바이올린 플롯20. 평가 시험의 41개 프레임은 모두 중앙값(흰색 원), 사분위수 범위(굵은 수직선) 및 평균(굵은 수평선)과 함께 데이터 포인트로 표시됩니다. 2° 및 1mm의 검은색 선은 선택한 임계값을 나타냅니다. (E)에서 New Operator 2에 대한 임계값을 벗어난 6개의 프레임은 표시되지 않습니다. 이 그림의 더 큰 버전을 보려면 여기를 클릭하십시오.

한 새로운 작업자는 경골 추적에서 2° 회전 임계값보다 6개 높은 프레임을 가지고 있었습니다. 프레임은 verifyAssessmentPoses.m에서 생성된 그래프 중 하나를 사용하여 식별되었습니다(그림 5). 이 6개의 프레임은 다른 발이 뷰를 스윙할 때 경골이 가려지기 때문에 추적하기가 더 어렵습니다.

그림 5: 스탠스 단계에 대한 각 프레임의 회전 바이어스. 달리기의 자세 단계의 일부에 대한 두 번째 새로운 작업자의 회전 추적의 예, (A) 종골, (B) 거골 및 (C) 경골에 대해. (C)의 빨간색 상자는 오류가 높은 프레임을 보여줍니다. (D) 왼쪽의 대표 이미지는 전방 경골의 주황색과 파란색 선(주황색과 검은색 화살표로 표시)의 대략적인 정렬 차이를 보여줍니다. 오른쪽 이미지는 잘 추적된 경골(흰색 화살표로 표시)의 예를 보여줍니다. 이 그림의 더 큰 버전을 보려면 여기를 클릭하십시오.

추가 파일. 이 파일을 다운로드하려면 여기를 클릭하십시오.

토론

정확한 모델 기반 포즈 추정은 절지 운동학과 골격 운동을 측정하는 데 기본이 됩니다. 포즈 추정을 위한 이전의 검증 방법은 생체 내 하중 및 관절 운동 범위 없이 마커가 이식된 시체 표본을 기반으로 했습니다. 마커 기반 포즈 추정을 사용한 달리기 및 호핑의 이 생체 내 데이터 세트를 통해 모델 기반 알고리즘을 검증할 수 있습니다. 또한 데이터 세트는 대부분의 모델 기반 알고리즘에 필요한 초기 추정치가 설정된 허용 오차 내에 있도록 새로운 연산자를 훈련하도록 구성되어 작업자 간 변동성을 줄입니다. 뼈대에 애니메이션을 적용할 수 있고 포즈 품질 피드백이 자동으로 생성될 수 있도록 MATLAB 코드가 제공됩니다.

새로운 작업자는 2°의 회전 및 1mm의 이동 허용 오차 내에서 성공적으로 교육을 받았습니다. 이러한 한계는 보고된 작업자 간 신뢰성보다 훨씬 낮으며, 최대 5mm 및 10°1에 달할 수 있습니다. 그러나 선택한 허용 오차는 다른 손상되지 않은 사체 발 실험의 RMS 오류(0.59mm 및 0.71°16)보다 2배에서 4배 높습니다. 허용 오차에는 RMS 오류의 상위 범위가 포함되지만 여전히 보고된 작업자 간 변동성에 비해 상당한 개선을 나타냅니다. 또한, 생체 내 조건은 뼈, 연조직 및 X-ray 볼륨을 통한 고속 움직임의 인공물의 폐색의 변화로 인해 정지된 발 자세보다 추적하기가 더 어렵습니다. 새로운 작업자는 허용 오차 내에서 시험을 성공적으로 로토스코핑했으며 그림 5C에 표시된 6개의 프레임을 제외하고는 전문가의 결과에 근접했습니다. 따라서 설정된 허용 오차는 보고된 조작자 간 변동성에 대한 개선을 나타내며, 결과는 이 방법이 해당 허용 오차 내에서 새 조작자를 성공적으로 훈련할 수 있음을 보여줍니다.

이 프로토콜에서 중요한 단계는 선택한 소프트웨어에서의 로토스코핑과 3D 시각화 간의 반복입니다. 이 반복은 뼈가 공간에서 어떻게 향하는지 이해하는 데 중요합니다. 이를 통해 작업자는 뼈 포즈가 생물학적으로 실현 가능하고 다른 뼈와 충돌하지 않는지 확인할 수 있습니다. 로토스코핑(rotoscoping)과 시각화(visualization)를 지속적으로 번갈아 가며 사용하면 최종 뼈 자세 추정치의 품질이 향상되고 최적화 오류를 포착하는 데 도움이 됩니다.

교육 세트, 특히 평가 시험에는 새로운 작업자의 한계를 뛰어넘기 위한 도전적인 추적 시나리오가 포함되어 있습니다. 이 컬렉션에서 X-ray 소스와 이미지 증폭 장치의 위치로 인해 스윙 풋이 시야를 가려 뼈 모델을 정렬하는 데 문제가 발생했습니다. 회전 임계값보다 여러 프레임이 높은 새 연산자는 뷰를 가리는 반대쪽 발의 영향을 받았습니다. 필터 설정을 변경하고 오클루젼 직전과 직후의 프레임을 로토스코핑하는 것과 같은 전략은 이러한 문제를 완화하는 데 도움이 될 수 있습니다. 또한, 좌표계의 방향이 DICOM과 포즈 추정 소프트웨어 간에 충분히 다르기 때문에 경골에서 각도 반전이 발생합니다. 작업자는 이 문제를 극복하기 위해 이 시점에서 모든 프레임을 추적해야 합니다. 이러한 시나리오는 데이터 수집에서 드문 일이 아니며 자동 모델 기반 포즈 추정이 미래에 탐색해야 하는 문제를 나타내므로 이 데이터 세트에 귀중한 추가 기능입니다.

이 프로토콜에는 특정 제한 사항이 있습니다. 첫째, 마커 기반 포즈 추정을 황금 표준으로 선언하는 것은 마커 기반 포즈 추정과 모델 기반 포즈 추정 간의 정확도 차이가 일반적으로 2,3,10의 큰 차이가 아니기 때문에 논쟁의 여지가 있습니다. 그러나 in vivo 컬렉션(즉, 움직임 아티팩트, 연조직 및 뼈 폐색)에서 발생하는 BVR 이미지의 시각적 변화는 마커 기반 방법에 비해 모델 기반 포즈 추정에서 오류를 유발할 가능성이 더 높습니다. 이 가설을 확인하기 위해서는 추가 실험이 필요합니다. 또한 이 데이터 세트는 모든 이평면 X선 수집을 캡처하지 않습니다. 뼈가 서로 다른 상대적 위치에 있도록 하는 카메라의 방향은 뼈 특징의 중요도를 변경할 수 있으며 그에 따라 포즈 일치 알고리즘의 비용 함수에 영향을 미칠 수 있습니다. 또한, 이러한 특징들은 이미지 필터 설정(15,17)에 의해 영향을 받을 수 있다. 따라서 이 데이터셋이 BVR 정확도에 대한 일반화 가능한 평가일 필요는 없습니다. 대신, 사용자가 적절한 초기 포즈 추정치를 입력하도록 교육하고 수동으로 로토스코핑된 초기 추측이 더 이상 필요하지 않을 때까지 모델 기반 포즈 추정 알고리즘을 개선하기 위한 도구입니다.

공개

저자는 공개할 이해 상충이 없습니다.

감사의 말

이 연구는 NSERC Discovery Grant(RGPIN/04688-2015)와 Ontario Early Researcher Award의 지원을 받았습니다.

자료

| Name | Company | Catalog Number | Comments |

| Autoscoper | Brown University | https://simtk.org/projects/autoscoper; pose estimation software | |

| Code | Queen's University | https://github.com/skelobslab/JOVE_BVR_FootModelAndMarker Based | |

| Content-Aware Fill algorithm, Photoshop | Adobe | ||

| Dataset | Queen's University | Download here | |

| MATLAB | Mathworks | n/a | computing platform |

| Mimics | Materialise, Belgium | 3D image processing software | |

| Revolution HD | General Electric Medical Systems | CT scan device used | |

| WristVisualizer | Brown University | https://github.com/DavidLaidlaw/WristVisualizer/tree/master; Visualization software | |

| XMALab | Brown University | https://bitbucket.org/xromm/xmalab/src/master/ |

참고문헌

- Maharaj, J. N., et al. The reliability of foot and ankle bone and joint kinematics measured with biplanar videoradiography and manual scientific rotoscoping. Frontiers in Bioengineering and Biotechnology. 8 (106), (2020).

- Iaquinto, J. M., et al. Model-based tracking of the bones of the foot: A biplane fluoroscopy validation study. Computers in Biology and Medicine. 92, 118-127 (2018).

- Miranda, D. L., et al. Static and dynamic error of a biplanar videoradiography system using marker-based and markerless tracking techniques. Journal of Biomechanical Engineering. 133 (12), 121002 (2011).

- Tashman, S., Anderst, W. In-vivo measurement of dynamic joint motion using high speed biplane radiography and CT: application to canine ACL deficiency. Journal of Biomechanical Engineering. 125 (2), 238-245 (2003).

- Brainerd, E. L., et al. X-ray reconstruction of moving morphology (XROMM): precision, accuracy and applications in comparative biomechanics research. Journal of Experimental Zoology Part A: Ecological Genetics and Physiology. 313 (5), 262-279 (2010).

- Challis, J. H. A procedure for determining rigid body transformation parameters. Journal of Biomechanics. 28 (6), 733-737 (1995).

- Lundberg, A., Goldie, I., Kalin, B. O., Selvik, G. Kinematics of the ankle/foot complex: plantarflexion and dorsiflexion. Foot & ankle. 9 (4), 194-200 (1989).

- You, B. -. M., Siy, P., Anderst, W., Tashman, S. In vivo measurement of 3-D skeletal kinematics from sequences of biplane radiographs: Application to knee kinematics. IEEE Transactions on Medical Imaging. 20 (6), 514-525 (2001).

- Bey, M. J., Zauel, R., Brock, S. K., Tashman, S. Validation of a new model-based tracking technique for measuring three-dimensional, in vivo glenohumeral joint kinematics. Journal of Biomechanical Engineering. 128 (4), 604-609 (2006).

- Anderst, W., Zauel, R., Bishop, J., Demps, E., Tashman, S. Validation of three-dimensional model-based tibio-femoral tracking during running. Medical Engineering & Physics. 31 (1), 10-16 (2009).

- Martin, D. E., et al. Model-based tracking of the hip: implications for novel analyses of hip pathology. The Journal of Arthroplasty. 26 (1), 88-97 (2011).

- Massimini, D. F. Non-invasive determination of coupled motion of the scapula and humerus-An in-vitro validation. Journal of Biomechanics. 44 (3), 408-412 (2011).

- Ito, K., et al. Direct assessment of 3D foot bone kinematics using biplanar X-ray fluoroscopy and an automatic model registration method. Journal of Foot and Ankle Research. 8 (1), 1-10 (2015).

- Wang, B., et al. Accuracy and feasibility of high-speed dual fluoroscopy and model-based tracking to measure in vivo ankle arthrokinematics. Gait & Posture. 41 (4), 888-893 (2015).

- Akhbari, B., et al. Accuracy of biplane videoradiography for quantifying dynamic wrist kinematics. Journal of Biomechanics. 92, 120-125 (2019).

- Cross, J. A., et al. Biplane fluoroscopy for hindfoot motion analysis during gait: A model-based evaluation. Medical Engineering & Physics. 43, 118-123 (2017).

- Akhbari, B., Morton, A. M., Moore, D. C., Crisco, J. J. Biplanar videoradiography to study the wrist and distal radioulnar joints. JoVE Journal of Visualized Experiments. (168), e62102 (2021).

- Knörlein, B. J., Baier, D. B., Gatesy, S. M., Laurence-Chasen, J. D., Brainerd, E. L. Validation of XMALab software for marker-based XROMM). Journal of Experimental Biology. 219 (23), 3701-3711 (2016).

- Söderkvist, I., Wedin, P. -. &. #. 1. 9. 7. ;. Determining the movements of the skeleton using well-configured markers. Journal of Biomechanics. 26 (12), 1473-1477 (1993).

- Violin Plots for Matlab. Available from: https://github.com/bastibe/Violinplot-Matlab (2021)

재인쇄 및 허가

JoVE'article의 텍스트 или 그림을 다시 사용하시려면 허가 살펴보기

허가 살펴보기This article has been published

Video Coming Soon

Copyright © 2025 MyJoVE Corporation. 판권 소유